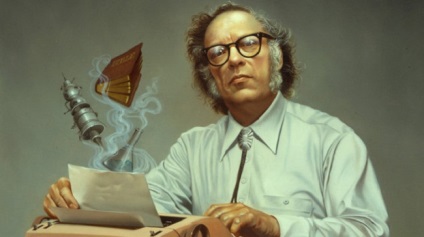

Acesta a fost de 50 de ani de când Isaac Asimov a inventat faimoasele sale trei legi ale roboticii - un set de reguli care trebuie urmate de nici un robot care se respecta. Deși inițial a fost doar un dispozitiv literar, cele trei legi au devenit rețeta originală pentru evitarea "robotocalipsis". Din fericire, există experți care studiază cu siguranță dacă garanțiile lui Asimov au trecut testul timpului. Din păcate, toți spun: nu.

În primul rând, amintim aceste trei legi:

- Robotul nu poate face rău unei persoane sau prin inacțiunea ei de a permite unei persoane să fie vătămată.

- Robotul trebuie să se supună tuturor ordinelor pe care o dă o persoană, cu excepția cazului în care aceste ordine sunt contrare Legii întâi.

- Robotul trebuie să aibă grijă de securitatea sa, în măsura în care nu contravine primului și celui de-al doilea lege.

Mai târziu, Azimov a adăugat o lege a patra sau zero, care preceda celelalte în ceea ce privește prioritatea:

0. Un robot nu poate face rău unei persoane decât dacă dovedește că în cele din urmă va fi benefic pentru întreaga umanitate.

În universul fantastic al lui Azimov, aceste legi urmau să fie urmate de aproape toți roboții. Acestea nu au fost doar sugestii sau linii directoare - în software-ul au fost incluse legi. În plus, aceste reguli nu pot fi eludate, rescrise sau revizuite.

Azimov însuși a relevat deficiențe, lacune și ambiguități în aceste legi adesea au dus la un comportament ciudat și ilogic de roboți. Legile erau prea vagi și adesea nu puteau identifica și distinge "oamenii" de "roboți". În plus, roboții ar putea încălca în mod inconștient legile, dacă informațiile complete nu le erau disponibile. De asemenea, un robot prea inteligent sau inteligență artificială ar fi trebuit să fie supus unei presiuni de a nu reprograma nucleul său.

"Când cineva mă întreabă ce s-ar fi întâmplat dacă cele trei legi de robotică ale mele au fost de fapt folosite pentru a determina comportamentul roboților, răspunsul este deja gata. Desigur, cu condiția ca roboții să fie suficient de flexibili și versatili pentru a avea comportamente diferite. Eu răspund: da, cele trei legi sunt singura opțiune prin care oamenii pot interacționa cu roboții - sau cu orice altceva.

După aproape treizeci de ani, am abordat realitatea în care vom avea roboți - sau, mai precis, inteligența artificială, pe care o gestionează - destul de flexibilă și versatilă pentru diferite cursuri de comportament. Rămâne doar o chestiune de timp: când o mașină va depăși o persoană în toate privințele, începând cu puterea fizică și terminând cu puterea imaginației.

Este înspăimântător faptul că practic nu există nici un drept să faci o greșeală. Dacă superinteligența artificială este prost programată sau indiferentă față de oameni, va duce la dezastru. Trebuie să asigurăm siguranța inteligenței artificiale, dacă vrem să supraviețuim aspectului său. "

Viitorul lui Azimov?

Conversația cu Hertzel și Helm a început cu ceea ce Asimov nu se înșela, predicând viitorul și ceea ce era în neregulă.

"Cred că tipul de roboți pe care Azimov a prevăzut-o va fi posibil în viitorul apropiat", răspunde Herzel. - Cu toate acestea, în majoritatea lumilor sale fictive, scriitorul a presupus că roboții umanoizi vor fi vârful roboticii și ingineria inteligenței artificiale. Acest lucru este puțin probabil. Foarte curând, după obținerea statutului de roboți Azimov, va deveni disponibilă crearea unei superinteligente artificiale și a unor super-roboți ".

Astfel, lumea tipică a viitorului în povești despre roboți în a lui Asimov, potrivit Herzl, va fi similară cu cea în care trăim astăzi, dar cu roboți inteligenți, plimbați pe străzi.

"Este puțin probabil ca acest lucru să se întâmple și, dacă se întâmplă, va fi întârziat pentru o perioadă scurtă de timp".

Pentru Helm, roboții par altfel.

„Problema principală, care este, în opinia mea, este cel mai important pentru omenire, nu este un regulament morală a numărului de umanoizi simțitoare pe jumătate gigant, și în cele din urmă dezvoltarea unor forme avansate de inteligență artificială (în orice organism). Această dezvoltare a superinteligenței este un filtru prin care umanitatea trebuie să treacă în cele din urmă. De aceea, elaborarea unei strategii de securitate pentru această tranziție este atât de importantă. Văd destul de ciudat că roboții, androizii sau „emularea“ va exista timp de zece ani, sau un pic mai mult, atâta timp cât omenirea se va confrunta cu o adevărată provocare pentru dezvoltarea eticii mașinii superintelligence. "

Un început bun?

Dacă luăm în considerare faptul că cele trei legi ale roboticii Azimovskaya au fost prima încercare reală de a rezolva o problemă foarte gravă - problema comportamentului în condiții de siguranță a mașinilor cu superintelligence artificiale - ar trebui să caute acele momente în care legile pot fi încă eficiente (sau cel puțin încurajarea).

"Sincer, nu găsesc nici o inspirație în aceste trei legi ale roboticii", spune Helm. - Esența eticii mașinilor este că ele nu satisfac baza eticii mașinilor. Poate că trei legi ale roboticii sunt cunoscute, dar de fapt sunt inutile ca bază pentru programare ".

"Din anumite motive, sistemul de etică bună - așa-numita deontologie - a devenit o bază falsă pentru etică. Există o serie de filosofi care încearcă să corecteze problemele deontologiei, însă sunt în cea mai mare parte aceiași oameni care caută "design inteligent" și "intervenție divină". Nimeni nu le ia în serios.

Deficiențele celor trei legi ale roboticii lui Asimov sunt următoarele:

- În mod controversat inerent

- Pe baza unei teorii etice depășite (deontologia)

- Nu lucra nici măcar în domeniul science fiction

"Sarcina celor trei legi era de a le viola într-un mod interesant; de aceea povestirile cu participarea lor sunt deosebit de distractive. Prin urmare, cele trei legi pot rămâne doar un exemplu moralizator de a nu face acest lucru. Dacă le luăm ca bază, ele au inevitabil lacune ".

Herzl consideră că, în realitate, aceste legi nu vor funcționa, deoarece termenii cu participarea lor sunt ambiguuți și rămân subiectul interpretării - ceea ce înseamnă că ei sunt extrem de dependenți de cei care fac traduceri.

Prejudecarea împotriva roboților?

Un alt aspect (și o potențială lipsă de) trei legi în șovinism simplu -predpolozhenie că roboții ar trebui să rămână, în ciuda puterii lor superioare, în persoana subordonarea nevoilor și priorităților umane.

"Viitoarea societate a lui Asimov este compusă în întregime din șoviniști: oamenii au mult mai multe drepturi decât roboții. Trei legi de robotică au fost create pentru a susține acest tip de ordine publică. "

Helm se uită la această problemă puțin diferit, argumentând că, dacă ne aflăm într-o astfel de situație, acest lucru va fi un indiciu că am trecut prea departe.

"Cred că ar fi nerezonabil să proiectăm un sistem de inteligență artificială sau un robot cu conștiința de sine. Și, spre deosebire de filme sau cărți în care creatorii de inteligență artificială „accidental“ vin la mașini inteligente, eu nu cred că în viața reală se poate întâmpla. Acest lucru va necesita prea mult efort și cunoștințe. Iar cei mai mulți dezvoltatori ai AI sunt oameni eminenți, astfel încât ei vor evita să creeze ceea ce filosofii numesc "ființe morale semnificative". Mai ales atunci când pot crea cu ușurință o mașină avansată care nu are implicații etice. "

Helm nu este preocupat de necesitatea de a dezvolta legi asimetrice care reglementează importanța roboților în comparație cu persoane care pretind (și speranța) că viitoarele creatorii inteligenței artificiale se va baza pe unele dintre constrângerile etice.

"Cred că oamenii sunt făcuți din atomi, deci în teorie un inginer poate crea o formă sintetică de viață sau un robot cu un înțeles moral. Aș vrea să cred că nimeni nu va face asta. Cred că și majoritatea oamenilor. Dar, în mod inevitabil, va fi un nebun, însetat de faima pionierului, chiar dacă este neetic și stupid.

Trei legi ale roboticii 2.0?

Având în vedere neajunsurile evidente ale celor trei legi ale tehnologiei robotului Azimov, resursa io9 a pus întrebarea: pot fi fixate sau modificate? De fapt, mulți scriitori de science fiction au încercat în mod repetat să facă acest lucru, modificându-se de mai mulți ani.

"Nu", spune Helm. "Nu există" patch-uri "pentru cele trei legi."

Pe lângă natura contradictorie, legile sunt de asemenea controversate.

"Sunt un sustinator al abordarii etice a masinilor, care este mai cooperativa, mai coerenta si bazata pe standarde si, prin urmare, se poate recupera din neintelegeri sau programare corecta gresita".

Herzl a relatat declarațiile lui Helm.

"Definirea unui set de porunci etice ca nucleu al eticii mecanice va fi fără speranță dacă mașina se bazează pe o inteligență artificială generală flexibilă. În cazul în care se dorește a fi un intuitiv, flexibil, adaptabil și etică - în acest context, poruncile etice vor fi utile pentru sistem doar ca un ghid dur pentru utilizarea propriilor intuiții etice. Dar, în acest caz, poruncile nu vor deveni baza sistemului etic, ci doar un aspect. Acest lucru poate fi considerat de exemplul oamenilor - principiile etice pe care le studiem, lucrăm, dar nu ca îndrumări, ele împing numai intuiția noastră și instinctele etice. Suntem practic independenți de principiile etice. "

Cum se creează o inteligență artificială sigură?

Având în vedere inadecvarea abordării juridice, se poate solicita lui Herzl și lui Helm abordări moderne privind problema "AI sigure".

"Foarte puțini cercetători ai inteligenței artificiale generale cred că există posibilitatea creării unui sistem care să fie complet sigur", spune Herzel. "Dar asta nu deranjează majoritatea, pentru că nimic nu poate fi garantat în această viață deloc".

Herzl a crezut că de îndată ce vom crea o inteligență artificială generală sau a fatului, putem efectua cercetări și experimente care ne spun despre etica AI-ul este mult mai mult decât știm.

"Sper că, în acest fel, vom putea să formăm teorii bune cu privire la etica inteligenței artificiale, care ne va permite să abordăm acest subiect. Dar acum este destul de dificil să teorizăm despre etica AI, pentru că nu avem doar teorii bune, nu avem deloc teorii. "

"Și pentru cei care au văzut prea mulți" terminatori ", procesul de creare a inteligenței artificiale poate părea descurajant, deoarece aceștia pierd cuvântul" primitiv "în acest context. Cu toate acestea, cele mai radicale schimbări au avut loc în acest fel ".

„Atunci când un grup de oameni ai cavernelor inteligente inventat limba, ei nu au așteptat pentru dezvoltarea unei teorii puternice limbaj formal, care ar putea ajuta pentru a anticipa schimbările viitoare cauzate de apariția limbajului în societate.“

Înainte de a lua în considerare dezvoltarea următoarelor "trei legi" ca o problemă tehnică, este necesar să se efectueze o mulțime de cercetare. Și în acest Helm și Herzel converg.

„Colegul meu de la MIRI Luca Myuelhauzer cuprinse argumentele noastre după cum urmează. El a spus că problemele trec de multe ori de la domeniul filozofiei la matematică și apoi în inginerie. Filosofia este adesea pusă la întrebările corecte, dar în modul cel mai puțin practic. Nimeni nu poate spune sigur dacă există progrese în rezolvarea problemei. Dacă putem reformula problemele importante filosofice asociate cu inteligenta, identitatea și valorile în formule exacte, care se pot ocupa de matematica, atunci putem construi un fel de model. O zi frumoasă va ajunge la inginerie. "

Helm consideră că această problemă este dificilă pentru știință și filozofie, dar progresul este posibil.

"Sunt sceptic că filosofia poate rezolva problema peste care sa luptat de mai bine de 3000 de ani. Dar noi, de asemenea, nu putem și vom începe să compilam modele matematice de întrebări care nu sunt punct de vedere tehnic. Avem nevoie de mai multe dezvoltări teoretice și chiar practice. "

Vor fi protejate cele trei legi de robotică? Ilya Hel